本文主要介绍智能制造和AI大模型能力的集成方法。

在应用配置文件 appsettings.json 中,添加 SemanticKernel 节点,用于配置大模型集成相关参数,具体配置示例如下:

{

……

"SemanticKernel": {

"Provider": "Ollama", //枚举值支持:AzureOpenAI/Ollama/None

"ModelName": "qwen3.5:0.8b",

"Endpoint": "http://localhost:11434/api",

"ApiKey": "SK1212123154648710",

"ServiceId": "",

"ModelId": ""

}

}

| 配置字段 | 字段说明 | 注意事项 |

|---|---|---|

| Provider | 指定LLM大模型驱动程序类型,为枚举值,仅支持 AzureOpenAI、Ollama、None 三种选项 | 1. 选择 AzureOpenAI:需自行申请AzureOpenAI相关接口信息并完成配置;2. 选择 Ollama:需提前完成Ollama本地环境的安装与部署;3. 选择 None:不启用任何大模型集成功能 |

| ModelName | 指定所使用的大模型名称 | 需前往对应大模型平台,查询并填写实际下载、部署的模型名称,确保与部署环境一致 |

| Endpoint | 指定大模型服务的请求地址 | 需根据实际部署环境或平台提供的地址填写,确保地址正确可访问 |

| ApiKey/ServiceId/ModelId | 鉴权及服务标识相关参数 | 需根据所选的大模型平台(AzureOpenAI/Ollama)提供的官方信息,如实填写对应参数;无需填写时可留空 |

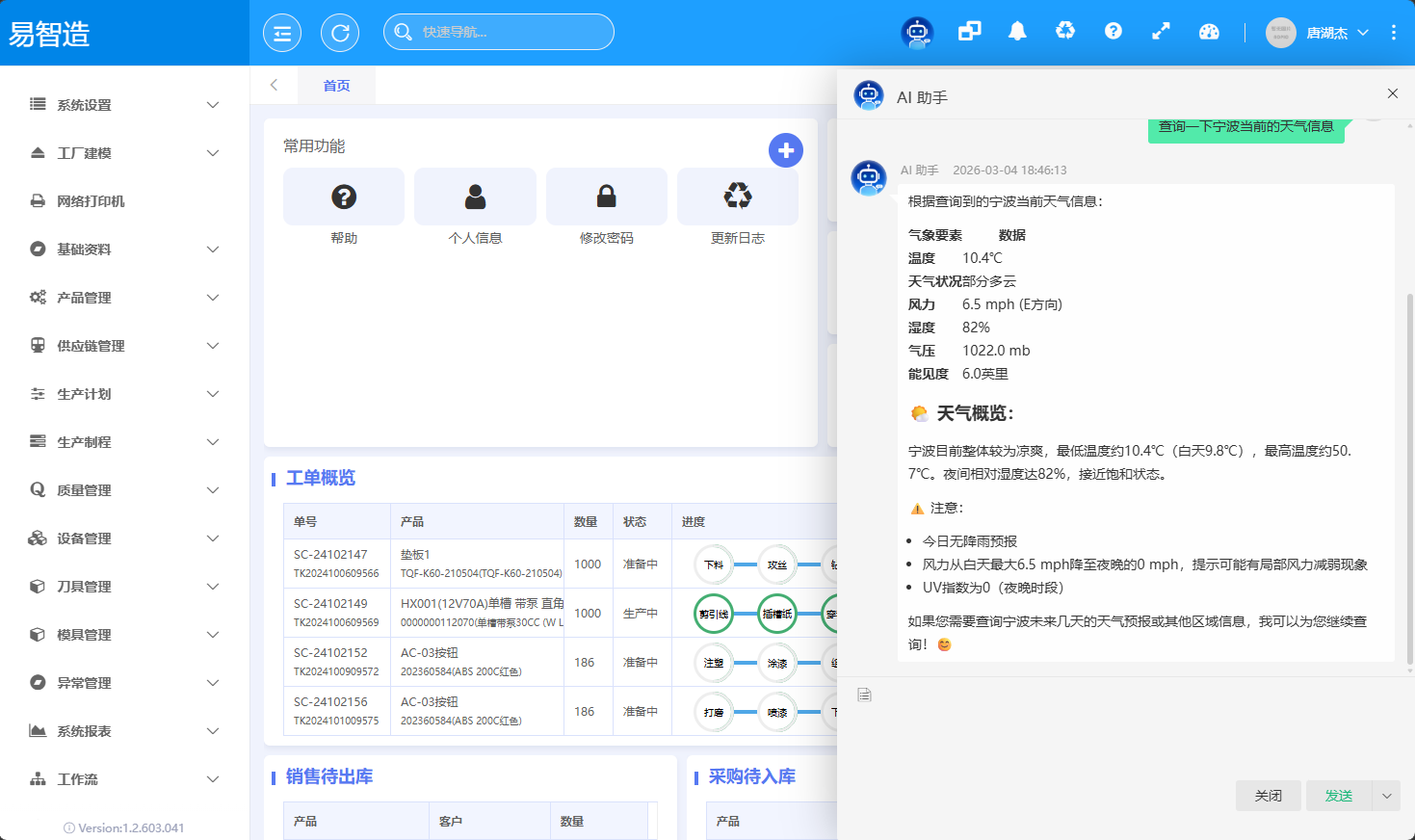

完成上述配置后,重启应用程序,即可在应用中看到AI功能入口。

当前版本仅支持基础的内容交互功能,后续将持续迭代优化,逐步集成更多实用能力,包括但不限于:数据报表查询、生产运营建议提供等场景,以满足更多业务需求。

注意:Ollama性能取决于服务器本身的性能,建议使用GPU运算模式,如果是CPU计算会影响服务器性能,请慎重选择。

工翼信息 2026 © Indgo.cn All Rights Reserved.

浙ICP备2023009385号

浙公网安备 33010602009975号

浙公网安备 33010602009975号

精选评论

分享您的观点